“人工智能威脅論”支持者霍金和馬斯克發(fā)出的那些驚人警告

時間:2017-03-21

(轉(zhuǎn)載自超多維superD,如有侵權(quán)請聯(lián)系刪除)

英特爾開發(fā)出了一整套幫助霍金說話的AI系統(tǒng)——通過眼動追蹤、聯(lián)想輸入和語音合成器播放來支持這位科學(xué)巨人與世界對話——但這仍沒能扭轉(zhuǎn)霍金對于未來人工智能發(fā)展的悲觀態(tài)度。

盡管他認(rèn)為,如今AI似乎已經(jīng)滲透到各個領(lǐng)域,甚至可幫助根除長期存在的社會挑戰(zhàn),比如疾病和貧困等,但他對于AI的擔(dān)憂卻與日俱增,關(guān)于AI的警告也越來越驚人。近日,霍金再發(fā)警告,稱人工智能將統(tǒng)治地球,真實版終結(jié)者即將上演。

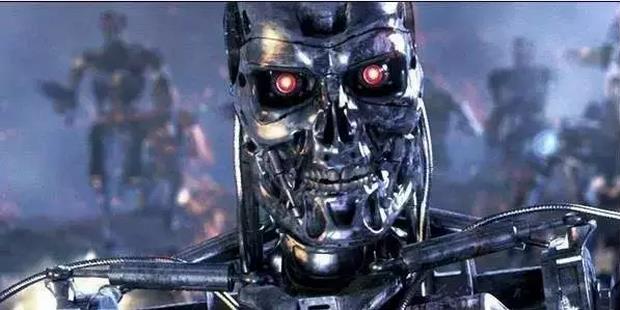

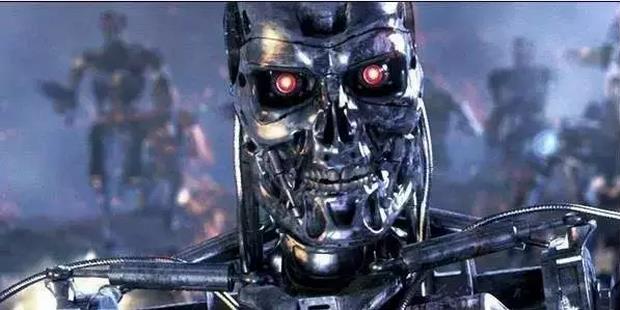

《終結(jié)者》中的天網(wǎng)人工智能防御系統(tǒng)最初是用于軍事防御的,但天網(wǎng)的自我意識被喚醒,視人類為威脅,從而發(fā)動了審判日。公元2029年,地球已被“天網(wǎng)”統(tǒng)治,人類幾乎被消滅殆盡。

霍金近四年來一直不遺余力地警示世人:AI對于人類具有毀滅性的危害。

2017年3月“人工智能已經(jīng)慢慢不受人類控制,以此發(fā)展下去,人類必將成為弱勢群體,而未來新科技(人工智能)進(jìn)一步發(fā)展便可能具備這種優(yōu)勢,它們可能會通過核戰(zhàn)爭或生物戰(zhàn)爭摧毀我們。”2016年12月霍金稱,人工智能的發(fā)展很可能會讓失業(yè)潮波及到中產(chǎn)階級。他還認(rèn)為,人工智能正在改變?nèi)祟愓谓?jīng)濟(jì)生活。特朗普當(dāng)選美國總統(tǒng)、英國脫歐這樣事件的發(fā)生,可能都有人工智能與自動化的因素。2016年10月在劍橋大學(xué)的演講中,霍金批評了人工智能的無節(jié)制發(fā)展,他認(rèn)為,人工智能可能帶來危險,比如強(qiáng)大的自主式武器,或者幫助少數(shù)人壓迫多數(shù)人。2016年6月“一旦機(jī)器到達(dá)能夠自我進(jìn)化的臨界階段,我們就無法預(yù)測它們的目標(biāo)是否會與我們的一致。人工智能有可能比人類進(jìn)化得快。我們需要確保人工智能的設(shè)計符合倫理,要有切實的安全措施。”2015年5月“人工智能可能在100年之內(nèi)取代人類。”2015年1月霍金稱,人工智能的誕生“可能是人類歷史上最重大的事件,但不幸的是,也可能是最后一件”。2014年12月“人工智能將變得依靠它自己,并且以前所未有的速度重新設(shè)計自己。最終,達(dá)到一定高度的智能會簡單地認(rèn)為人類是無用的累贅......人工智能的全面發(fā)展可能導(dǎo)致人類的滅絕。”2014年6月“機(jī)器人遲早會變得比我們更聰明。”2014年5月“人工智能的道德與善良程度,取決于誰在控制它。”

事實上,除了霍金,比爾·蓋茨、伊隆·馬斯克等科技界巨頭都曾公開發(fā)表言論,告誡人們應(yīng)該警惕人工智能技術(shù)。馬斯克和霍金還因此獲得過IT與創(chuàng)新基金會頒發(fā)的“阻礙創(chuàng)新”獎。2015年,霍金和馬斯克聯(lián)合12000名企業(yè)家、名流,簽署公開信,呼吁聯(lián)合國發(fā)布禁止自動化武器法案,并提醒科學(xué)家和研發(fā)人員關(guān)注強(qiáng)人工智能的潛在威脅。

特斯拉創(chuàng)始人伊隆·馬斯克(Elon Musk)曾與霍金一起建立了人工智能防范聯(lián)盟。他與霍金持有相同的觀點,認(rèn)為“人工智能是我們最大的生存威脅”。來看看他針對AI發(fā)出的警示語。

2017年馬斯克指出,人類必須與機(jī)器相結(jié)合,否則將被人工智能淘汰。2016年6月伴隨著人工智能機(jī)器人的快速發(fā)展,人類智商會停滯不前,很可能被機(jī)器人視為“寵物”。2014年10月“如果讓我猜人類最大生存威脅,我認(rèn)為可能是人工智能。因此我們需要對人工智能保持萬分警惕,研究人工智能如同在召喚惡魔。”2014年8月他在twitter上說到,“我們需要超級關(guān)注人工智能。它的潛在危險性超過核武器”。

比爾·蓋茨(BillGates)最初也是人工智能威脅論的只要支持者之一。早在2015年初,他就稱,人工智能或?qū)缛祟悺Kf:“如果我們能夠很好地駕馭,機(jī)器能夠為人類造福,但如果若干年后機(jī)器發(fā)展得足夠智能就將成為人類的心頭大患。”后來隨著時間推移,比爾·蓋茨對它的言論實行了降溫,稱人工智能威脅人類還為時過早,但并未改變一貫的威脅論觀點。

2015年,牛津大學(xué)人類未來研究所與全球挑戰(zhàn)基金會的研究團(tuán)隊發(fā)布首份科學(xué)評估人類未來風(fēng)險的報告,列舉了最有可能毀滅人類文明的12大風(fēng)險,其中排在第一位的正是AI。報告稱,人類也許無法輕易控制極端的人工智能,可能它們會利用自身智慧最大限度攫取資源。

而谷歌的技術(shù)總監(jiān)RayKurzweil的擔(dān)憂則更為細(xì)致深層,他認(rèn)為無論技術(shù)發(fā)展如何迅猛,人們也不可能編寫出足以限制住這種絕對智能的道德編碼。

事實上,人類現(xiàn)實生活中人工智能技術(shù)早已無處不在,無論互聯(lián)網(wǎng)搜索、蘋果Siri和亞馬遜Alexa等虛擬助理、安全門禁系統(tǒng)、實時交通調(diào)度……后面都是AI技術(shù)在作關(guān)鍵支撐,并且已經(jīng)為人類帶來了前所未有的便利。而AI進(jìn)入醫(yī)療、教育、娛樂、零售、物流等眾多領(lǐng)域,也為人類發(fā)展歷程開啟了新的篇章,我們期待人工智能在可控范圍之內(nèi)進(jìn)入更多領(lǐng)域造福人類。

英特爾開發(fā)出了一整套幫助霍金說話的AI系統(tǒng)——通過眼動追蹤、聯(lián)想輸入和語音合成器播放來支持這位科學(xué)巨人與世界對話——但這仍沒能扭轉(zhuǎn)霍金對于未來人工智能發(fā)展的悲觀態(tài)度。

盡管他認(rèn)為,如今AI似乎已經(jīng)滲透到各個領(lǐng)域,甚至可幫助根除長期存在的社會挑戰(zhàn),比如疾病和貧困等,但他對于AI的擔(dān)憂卻與日俱增,關(guān)于AI的警告也越來越驚人。近日,霍金再發(fā)警告,稱人工智能將統(tǒng)治地球,真實版終結(jié)者即將上演。

《終結(jié)者》中的天網(wǎng)人工智能防御系統(tǒng)最初是用于軍事防御的,但天網(wǎng)的自我意識被喚醒,視人類為威脅,從而發(fā)動了審判日。公元2029年,地球已被“天網(wǎng)”統(tǒng)治,人類幾乎被消滅殆盡。

霍金近四年來一直不遺余力地警示世人:AI對于人類具有毀滅性的危害。

2017年3月“人工智能已經(jīng)慢慢不受人類控制,以此發(fā)展下去,人類必將成為弱勢群體,而未來新科技(人工智能)進(jìn)一步發(fā)展便可能具備這種優(yōu)勢,它們可能會通過核戰(zhàn)爭或生物戰(zhàn)爭摧毀我們。”2016年12月霍金稱,人工智能的發(fā)展很可能會讓失業(yè)潮波及到中產(chǎn)階級。他還認(rèn)為,人工智能正在改變?nèi)祟愓谓?jīng)濟(jì)生活。特朗普當(dāng)選美國總統(tǒng)、英國脫歐這樣事件的發(fā)生,可能都有人工智能與自動化的因素。2016年10月在劍橋大學(xué)的演講中,霍金批評了人工智能的無節(jié)制發(fā)展,他認(rèn)為,人工智能可能帶來危險,比如強(qiáng)大的自主式武器,或者幫助少數(shù)人壓迫多數(shù)人。2016年6月“一旦機(jī)器到達(dá)能夠自我進(jìn)化的臨界階段,我們就無法預(yù)測它們的目標(biāo)是否會與我們的一致。人工智能有可能比人類進(jìn)化得快。我們需要確保人工智能的設(shè)計符合倫理,要有切實的安全措施。”2015年5月“人工智能可能在100年之內(nèi)取代人類。”2015年1月霍金稱,人工智能的誕生“可能是人類歷史上最重大的事件,但不幸的是,也可能是最后一件”。2014年12月“人工智能將變得依靠它自己,并且以前所未有的速度重新設(shè)計自己。最終,達(dá)到一定高度的智能會簡單地認(rèn)為人類是無用的累贅......人工智能的全面發(fā)展可能導(dǎo)致人類的滅絕。”2014年6月“機(jī)器人遲早會變得比我們更聰明。”2014年5月“人工智能的道德與善良程度,取決于誰在控制它。”

事實上,除了霍金,比爾·蓋茨、伊隆·馬斯克等科技界巨頭都曾公開發(fā)表言論,告誡人們應(yīng)該警惕人工智能技術(shù)。馬斯克和霍金還因此獲得過IT與創(chuàng)新基金會頒發(fā)的“阻礙創(chuàng)新”獎。2015年,霍金和馬斯克聯(lián)合12000名企業(yè)家、名流,簽署公開信,呼吁聯(lián)合國發(fā)布禁止自動化武器法案,并提醒科學(xué)家和研發(fā)人員關(guān)注強(qiáng)人工智能的潛在威脅。

特斯拉創(chuàng)始人伊隆·馬斯克(Elon Musk)曾與霍金一起建立了人工智能防范聯(lián)盟。他與霍金持有相同的觀點,認(rèn)為“人工智能是我們最大的生存威脅”。來看看他針對AI發(fā)出的警示語。

2017年馬斯克指出,人類必須與機(jī)器相結(jié)合,否則將被人工智能淘汰。2016年6月伴隨著人工智能機(jī)器人的快速發(fā)展,人類智商會停滯不前,很可能被機(jī)器人視為“寵物”。2014年10月“如果讓我猜人類最大生存威脅,我認(rèn)為可能是人工智能。因此我們需要對人工智能保持萬分警惕,研究人工智能如同在召喚惡魔。”2014年8月他在twitter上說到,“我們需要超級關(guān)注人工智能。它的潛在危險性超過核武器”。

比爾·蓋茨(BillGates)最初也是人工智能威脅論的只要支持者之一。早在2015年初,他就稱,人工智能或?qū)缛祟悺Kf:“如果我們能夠很好地駕馭,機(jī)器能夠為人類造福,但如果若干年后機(jī)器發(fā)展得足夠智能就將成為人類的心頭大患。”后來隨著時間推移,比爾·蓋茨對它的言論實行了降溫,稱人工智能威脅人類還為時過早,但并未改變一貫的威脅論觀點。

2015年,牛津大學(xué)人類未來研究所與全球挑戰(zhàn)基金會的研究團(tuán)隊發(fā)布首份科學(xué)評估人類未來風(fēng)險的報告,列舉了最有可能毀滅人類文明的12大風(fēng)險,其中排在第一位的正是AI。報告稱,人類也許無法輕易控制極端的人工智能,可能它們會利用自身智慧最大限度攫取資源。

而谷歌的技術(shù)總監(jiān)RayKurzweil的擔(dān)憂則更為細(xì)致深層,他認(rèn)為無論技術(shù)發(fā)展如何迅猛,人們也不可能編寫出足以限制住這種絕對智能的道德編碼。

事實上,人類現(xiàn)實生活中人工智能技術(shù)早已無處不在,無論互聯(lián)網(wǎng)搜索、蘋果Siri和亞馬遜Alexa等虛擬助理、安全門禁系統(tǒng)、實時交通調(diào)度……后面都是AI技術(shù)在作關(guān)鍵支撐,并且已經(jīng)為人類帶來了前所未有的便利。而AI進(jìn)入醫(yī)療、教育、娛樂、零售、物流等眾多領(lǐng)域,也為人類發(fā)展歷程開啟了新的篇章,我們期待人工智能在可控范圍之內(nèi)進(jìn)入更多領(lǐng)域造福人類。

相關(guān)閱讀:

-

分享本文到:

-

關(guān)注隨銳:

微信掃描,獲取最新資訊 -

聯(lián)系我們:

如果您有任何問題或建議,

請與我們聯(lián)系:

suiruikeji@suirui.com

矚目客戶端

矚目客戶端 矚目小T

矚目小T 矚目大板

矚目大板 矚目會議室系統(tǒng)

矚目會議室系統(tǒng) 矚目直播

矚目直播

多媒體通信平臺

多媒體通信平臺 多媒體通信終端

多媒體通信終端 多媒體通信軟件

多媒體通信軟件 網(wǎng)絡(luò)音頻處理器

網(wǎng)絡(luò)音頻處理器

變電站智能巡檢機(jī)器人

變電站智能巡檢機(jī)器人 發(fā)電廠智能巡檢機(jī)器人

發(fā)電廠智能巡檢機(jī)器人 配電室智能巡檢機(jī)器人

配電室智能巡檢機(jī)器人 室內(nèi)工業(yè)智能巡檢機(jī)器人

室內(nèi)工業(yè)智能巡檢機(jī)器人 機(jī)器人遠(yuǎn)程專家診斷協(xié)同平臺解決方案

機(jī)器人遠(yuǎn)程專家診斷協(xié)同平臺解決方案

掃碼關(guān)注微信眾公號

掃碼關(guān)注微信眾公號 抖音掃一掃 關(guān)注隨銳

抖音掃一掃 關(guān)注隨銳 China

China